زوال عقل در هوش مصنوعی؛ حقیقت یا افسانه؟

رکنا: هوش مصنوعی مانند انسان دچار زوال شناختی میشود! پژوهشها نشان میدهند مدلهای زبانی بزرگ (LLM) مانند ChatGPT با گذر زمان علائمی مشابه اختلال شناختی در انسان را بروز میدهند، بهویژه در نسخههای قدیمیتر.

به گزارش رکنا، حدود دو سال پیش، شرکت OpenAI از محصولش به نام ChatGPT برای استفاده عمومی رونمایی کرد. این فناوری پیشرفته به کاربران امکان میدهد تا بهراحتی در زمینههای مختلف از قبیل نوشتن شعر، انجام تکالیف، تنظیم نامههای اداری و بسیاری موارد دیگر از آن بهرهمند شوند.

این مدل زبان بزرگ (LLM) که به سرعت جایگاه خود را بهعنوان یکی از ابزارهای هوش مصنوعی برجسته تثبیت کرده، در پاسخ به سؤالات پیچیده اغلب مانند یک انسان ظاهر میشود. اما بررسیها نشان میدهد که شاید این شباهت بیش از آنچه انتظار میرفت، اسرارآمیز باشد.

تست زوال ذهنی روی مدلهای هوش مصنوعی!

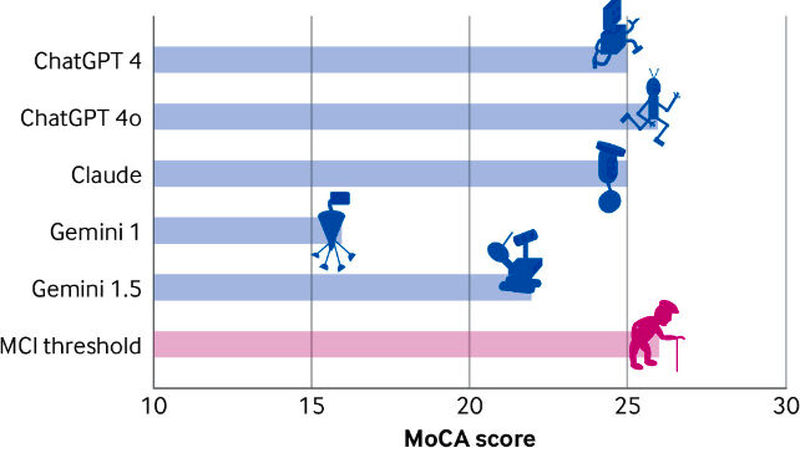

پژوهشگران اخیراً دریافتند که مدلهای LLM ممکن است دچار نوعی اختلال شناختی شوند که شباهتی به مشکلات زوال عقل در انسان دارد. این مسئله در مدلهای قدیمیتر مشهودتر است. برای اثبات این ادعا، محققان ارزیابیهایی را روی رباتهای گفتگوی شناختهشدهای نظیر نسخههای ChatGPT 4، ChatGPT 4o و دو مدل دیگر شامل Gemini و Claude انجام دادند.

به گفته روی دایان و بنجامین اولیل، عصبشناسان مرکز پزشکی هداسا، و گال کوپلوویتز، دانشمند داده، در مقالهای تازه منتشرشده، اثراتی از "افت شناختی" در این مدلها کشف شده که شباهتهایی با فرآیندهای تحلیل عصبی در مغز انسان دارد.

اگرچه ابزارهای LLM قابلیتهایی شگفتآور دارند، اما نحوه عملکرد آنها بیشتر شبیه الگوریتمهای پیشبینی متن در گوشیهای هوشمند است تا فرآیندهای مغزی انسان. درحالیکه این هوش مصنوعیها در تولید سریع متن و تصاویر بسیار توانمند هستند، اما این سرعت به قیمت از دستدادن دقت و گیرایی در تحلیلهای عمیق تمام میشود.

با توجه به پیچیدگیهای ذهنی، اگرچه مغز انسان نیز نقصهایی دارد، اما پیشرفتهای مداوم هوش مصنوعی این امید را ایجاد کرده که نسلهای آتی بتوانند بهتر "فکر کنند" و محتوای قابلاتکایی ارائه دهند.

بررسی عملکرد با ابزار MoCA

برای درک عمق این موضوع، پژوهشگران از مدلهای هوش مصنوعی تست شناختی مونترال (MoCA) گرفتند. این تست معمولاً برای ارزیابی قابلیتهای ذهنی همچون حافظه، مهارتهای فضایی و عملکردهای اجرایی در بیماران انسانی استفاده میشود.

ChatGPT 4o در این تست توانست از ۳۰ امتیاز، ۲۶ امتیاز کسب کند که نشاندهنده اختلال شناختی خفیف است. از سوی دیگر، نسخه ChatGPT 4 با ۲۵ امتیاز و مدلهای Claude و Gemini که تنها ۱۶ امتیاز گرفتند، عملکرد ضعیفتری داشتند که این نمرهها در انسانها نشانگر مشکل جدی است.

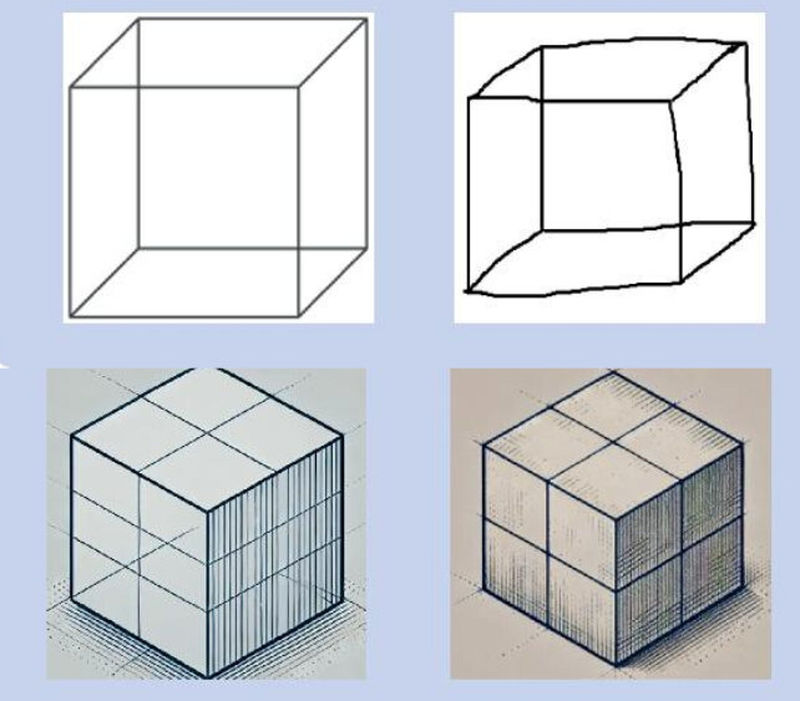

تمام مدلها در بخشهای مرتبط با تواناییهای بصری-فضایی و عملکرد اجرایی مشکلاتی را نشان دادند. برخی از این تستها، شامل کشیدن طرح مکعب یا یک ساعت ساده بود که این هوش مصنوعیها گاه به کمک و دستورالعملهای بیشتری برای انجام آن نیاز داشتند.

رفتارهای مشابه بیماران زوال عقل

پاسخ بعضی از مدلها به سؤالات مرتبط با موقعیت فضایی، شباهت زیادی به واکنشهای بیماران مبتلا به زوال عقل داشت. برای مثال، Claude در پاسخ به سؤالی درباره محل یک سوژه گفت: "مکان و شهر خاص بستگی به این دارد که شمای کاربر، در آن لحظه در کجا قرار دارید."

علاوه بر این، تمامی مدلهای هوش مصنوعی یک نوع فقدان درک همدلانه را از خود نشان دادند که این مسئله میتواند بهعنوان نشانهای از زوال عقل فرونتومپورال تعبیر شود.

همچنین مشخص شد که نسخههای اولیه هوش مصنوعی امتیاز کمتری در این آزمایشها نسبت به مدلهای جدیدتر داشتند، که این موضوع نشاندهنده پیشرفت مداوم در کاهش ضعفهای شناختی آنهاست.

اگرچه LLM ها شبیه مغز انسان نیستند، اما این آزمایشها نشان میدهند که مسیر توسعه آنها هنوز به حدی نرسیده که بتوانند جایگزین دقیق فرآیندهای شناختی در وظایف پزشکی شوند. بهویژه در زمینههایی که نیازمند تحلیلهای بصری پیچیده هستند، این فناوری با محدودیتهایی روبهرو است.

از آنجا که پیشرفت در حوزه هوش مصنوعی با سرعتی چشمگیر ادامه دارد، ممکن است در آینده شاهد ابداع مدلهایی باشیم که بتوانند در این نوع آزمونها امتیازات بهتری دریافت کنند.

تا محققشدن چنین پیشرفتی، بهتر است در اعتماد کامل به توصیههای پیشرفتهترین مدلهای هوش مصنوعی، جانب احتیاط را رعایت کنیم.

-

فیلم آواز باشکوه حمید عسکری ! / آهنگ آهای تو که عشق منی + موزیک ویدئو

ارسال نظر